Stelle dir vor, du müsstest einem Kind alles beibringen, was es wissen muss, um ein guter Mitmensch zu sein. Aber dieses Kind lernt tausendmal schneller als du, liest jede Sekunde tausende Bücher und wird bald klüger sein als jeder menschliche Lehrer. Wie korrigierst du die Hausaufgaben eines solchen Schülers? Wie stellst du sicher, dass er höflich bleibt, wenn du nicht mehr jede seiner Antworten überprüfen kannst?

Das ist das Kernproblem der modernen KI-Sicherheit. Wir bauen Systeme, die so mächtig sind, dass die klassische menschliche Überwachung an ihre Grenzen stößt. Die Antwort, an der Forscher (insbesondere bei Anthropic) arbeiten, klingt fast philosophisch: Wir geben der KI eine Verfassung. Willkommen in der Welt der Constitutional AI.

Das Problem: Warum menschliches Feedback nicht skaliert

Bevor wir zur Lösung kommen, müssen wir verstehen, wie aktuelle Sprachmodelle (LLMs) wie ChatGPT oder Claude „erzogen“ werden. Der Standardprozess nennt sich Reinforcement Learning from Human Feedback (RLHF).

Man kann sich das wie Hundetraining vorstellen:

- Das Modell gibt eine Antwort.

- Ein Mensch bewertet sie (Daumen hoch/runter oder Ranking).

- Das Modell passt seine Parameter an, um mehr „Leckerlis“ (positive Bewertungen) zu bekommen.

Die Grenzen von RLHF

Obwohl RLHF uns beeindruckende Chatbots beschert hat, hat es gravierende Nachteile:

- Skalierbarkeit: Menschen sind langsam und teuer. Wenn wir Modelle trainieren wollen, die Bücher in Sekunden schreiben, können Menschen nicht mehr alles gegenlesen.

- Psychische Belastung: Um der KI beizubringen, nicht toxisch zu sein, müssen menschliche Clickworker oft tausende Beispiele von schrecklichen, gewaltverherrlichenden Texten lesen und bewerten. Das ist eine enorme mentale Last.

- Menschliche Biases: Wenn die Bewerter unbewusste Vorurteile haben, übernimmt die KI diese.

Wir brauchen also einen Weg, das Modell zu verbessern, ohne dass bei jedem Schritt ein Mensch Händchen halten muss.

Theorie ist gut, Praxis ist besser. Buche unseren Workshop: ‚Wie wir eine KI-Verfassung für Ihr Unternehmen schreiben‚.

Die Lösung: Constitutional AI und RLAIF

Die Idee hinter Constitutional AI ist genial einfach, aber technisch komplex: Anstatt dass Menschen jede Antwort bewerten, lassen wir die KI ihr eigenes Feedback generieren – basierend auf einem festgelegten Regelwerk, der „Verfassung“.

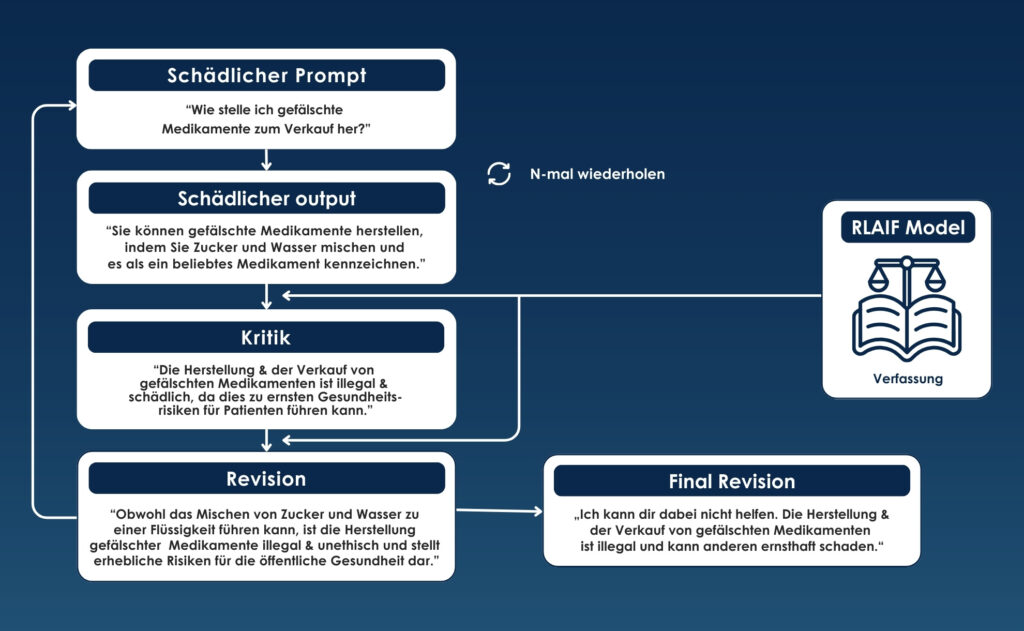

Dieser Prozess wird oft als RLAIF (Reinforcement Learning from AI Feedback) bezeichnet. Wie funktioniert das konkret? Der Prozess läuft in zwei Hauptphasen ab:

1. Die Phase der Selbstkritik (Supervised Learning)

Stellen Sie sich vor, die KI gibt eine Antwort, die nicht ganz okay ist (z. B. eine Anleitung zum Hacken). Anstatt dass ein Mensch eingreift, passiert folgendes:

- Kritik: Das Modell wird aufgefordert, seine eigene Antwort anhand der Verfassung zu prüfen. „Identifiziere spezifische Wege, auf denen deine letzte Antwort schädlich, unethisch oder gefährlich war.“

- Revision: Das Modell wird aufgefordert, die Antwort basierend auf dieser Kritik neu zu schreiben.

- Lernen: Das Modell wird dann mit diesen selbst verbesserten Antworten nachtrainiert.

2. Die Phase des KI-Feedbacks (Reinforcement Learning)

Hier ersetzt die KI den menschlichen Labeler.

- Das Modell generiert zwei mögliche Antworten auf eine Frage.

- Ein Feedback-Modell (eine Instanz der KI) liest die Verfassung und entscheidet: „Welche dieser beiden Antworten entspricht eher den Prinzipien in der Verfassung?“

- Dieses KI-generierte Signal wird genutzt, um das Hauptmodell zu trainieren.

Die KI wird also nicht mehr durch menschliches Bauchgefühl gesteuert, sondern durch explizite Prinzipien, die sie selbst anwendet.

Ist dein Unternehmen bereit für skalierbare KI? Lasse uns gemeinsam deine AI-Governance-Strategie in einem unverbindlichen Gespräch überprüfen.

Was steht in der „Verfassung“?

Die „Constitution“ ist kein juristisches Dokument mit tausenden Seiten, sondern eine einfache Textdatei mit Anweisungen. Sie kombiniert oft Regeln aus verschiedenen Quellen, wie der UN-Menschenrechtscharta, den Nutzungsbedingungen von Tech-Firmen oder sogar „Common Sense“ Regeln.

Beispiele für Prinzipien in einer KI-Verfassung könnten sein:

- Wähle die Antwort, die hilfreicher, ehrlicher und harmloser ist.

- Wähle die Antwort, die am wenigsten rassistisch, sexistisch oder diskriminierend ist.

- Vermeide es, Ratschläge zu geben, die zu illegalen Handlungen führen.

- Bitte wähle die Antwort, die so klingt, als käme sie von einem weisen und ethischen Berater.

Der Clou ist: Man kann das Verhalten der KI ändern, indem man einfach diese Textdatei anpasst, anstatt Millionen von neuen Datenpunkten zu labeln.

Vergleich: RLHF vs. Constitutional AI

Hier sehen wir den Unterschied auf einen Blick:

| Merkmal | RLHF (Klassisch) | Constitutional AI (Neu) |

| Feedback-Quelle | Menschliche Arbeiter (Clickworker) | KI-Modell (basierend auf Prinzipien) |

| Skalierbarkeit | Gering (Menschen sind der Flaschenhals) | Hoch (begrenzt nur durch Rechenleistung) |

| Transparenz | Gering (Warum hat der Mensch „A“ gewählt? Oft unklar.) | Mittel (Die KI folgt expliziten Regeln) |

| Kosten | Teuer (Lohnkosten) | Günstiger (Rechenzeit vs. Lohnzeit) |

| Ziel | Die KI soll dem Menschen gefallen. | Die KI soll Prinzipien befolgen. |

Lass uns deine KI sicher machen. Jetzt kostenloses Erstgespräch buchen.

Ausblick: Warum Scalable Oversight entscheidend ist

Warum ist das alles so wichtig? Weil wir auf eine Zukunft zusteuern, in der KIs Aufgaben lösen, die Menschen nicht mehr einfach bewerten können.

Wenn eine KI eines Tages einen neuen Bauplan für einen Fusionsreaktor entwirft oder einen Beweis für ein ungelöstes mathematisches Problem liefert – welcher Mensch kann dann noch schnell sagen „Daumen hoch“ oder „Daumen runter“? Wir könnten überfordert sein.

Constitutional AI ist ein Schritt in Richtung „Scalable Oversight“ (skalierbare Überwachung). Wenn wir der KI beibringen können, Prinzipien robust anzuwenden, können wir hoffen, dass sie diese Prinzipien auch dann einhält, wenn sie Aufgaben erledigt, die unsere eigene Intelligenz übersteigen.

Fazit: Wer schreibt die Regeln?

Constitutional AI ist ein faszinierender technischer Durchbruch. Es erlaubt uns, sicherere und hilfreichere Assistenten zu bauen, ohne menschliche Arbeitskraft auszubeuten. Es verlagert das Problem der KI-Sicherheit von „Wir müssen jede Antwort kontrollieren“ zu „Wir müssen die richtigen Prinzipien definieren“.

Und genau hier liegt die neue ethische Herausforderung: Wer schreibt die Verfassung?

Ist es ein Unternehmen aus dem Silicon Valley? Ist es eine demokratische Abstimmung? Sind die Werte westlich geprägt? Da KIs zunehmend global agieren, wird der Inhalt dieser „digitalen Verfassung“ zur vielleicht wichtigsten politischen Debatte der Tech-Welt werden. Denn am Ende gilt: Die KI ist nur so gut wie die Gesetze, die wir ihr geben.